Dissertation in Easy Language

I’m convinced that scientific insights must not only be publicly available but also widely comprehensible. Therefore, I published my doctoral dissertation open-access under the Creative Commons license. Here is an explanation of my research for a non-academic audience, avoiding technical terms.

For German speakers, here is an infographic providing an overview of the core idea behind my PhD work.

Like Holding a Lightsaber in My Hand

With virtual reality technology, we can experience artificial worlds that feel astonishingly real. For applications in medicine, education, and gaming, these simulations must be realistic. My research shows what realism depends on – and why less can sometimes be more.

As a child, I dreamed of being a Jedi. With my imagination, I made things float and swung around with a stick as if it were a lightsaber. Today, virtual reality technology brings me closer to that Jedi feeling than ever before. When I immerse myself in virtual reality (VR), I can elegantly swing a glowing blue lightsaber around me with its iconic sound. It’s like being in a blockbuster movie – except I’m right in the middle of it.

Continue reading…

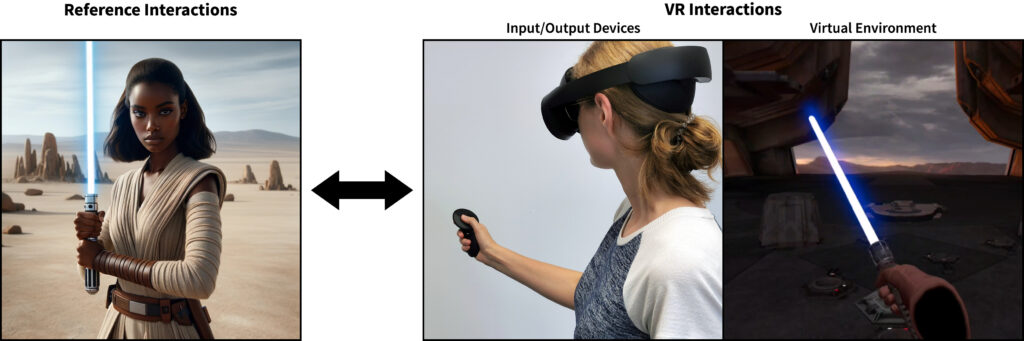

Instead of staring at a flat screen, I see the world through VR goggles and am directly in the action. If I turn toward a sound behind me, the virtual world continues there. I don’t just see and hear the planet Tatooine – I can bend down to pick up a sandy rock and toss it to Luke Skywalker, by using my body instead of a keyboard and mouse. Yet, I immediately recognize that I’m only experiencing a simulation. I feel the heavy headset pressing on my nose and, fortunately, I can’t injure myself with the lightsaber. My impression of this world: quite realistic, yet clearly distinguishable from reality.

This gut feeling is quickly formed, but “quite realistic” is rather vague from a scientific perspective. This is where my doctoral research comes in, with the central question: How realistic are interactions in virtual reality, and what is the effect? In my dissertation, I explored which factors make a VR experience more or less realistic, how to describe them precisely, and what this means for the development of virtual experiences.

Now, anyone who has never been to Tatooine might wonder: How can a lightsaber be realistic if it doesn’t actually exist? The term “fidelity” describes this better than “realism.” You may be familiar with the term from high-fidelity audio (Hi-Fi). High fidelity means that a copy or simulation is very similar to the original. So, what determines how closely my virtual Jedi training matches the original from Star Wars?

There is an impressive variety of sophisticated solutions and technologies for VR applications. For example, different devices: Do I grab a virtual object with a controller or with special gloves? Or various software solutions: Are detailed shadows calculated, or does the world look like a comic? The same applies to interaction methods: Can I operate a menu using my voice or my eye movements?

To compare realism clearly amid all this technical complexity, I developed the Interaction Fidelity Model. This model guides us through the analysis. With a clear structure and unambiguous terms, it helps us understand all the factors influencing fidelity. This is helpful for team communication, as it helps avoid misunderstandings and ensures nothing is overlooked.

The structure of the model is simple. All stages of interaction between a human and a computer are covered in a circle: The system recognizes our behavior (input), adapts the simulation accordingly (processing), and calculates the system’s feedback (output), which we see and feel (perception). In practice, all of this happens simultaneously, as we constantly influence and perceive the simulation through our behavior. However, this cycle is often divided into eight stages to better understand the individual processes.

Each of these stages corresponds to a realism factor in my model. For example, the first step is how I behave as a user – whether I move, press a button, or say something. For our analysis of fidelity, we ask how closely my behavior in VR matches that of a Jedi. I call this factor “Action Fidelity.” If I press a button to hold the lightsaber, that’s low action fidelity. If I grasp the virtual lightsaber handle with my hand, that’s high action fidelity. In total, we have eight of these factors, which allow us to analyze any interaction with VR systems systematically.

Another example is “Display Fidelity.” This factor describes how faithfully the system represents the simulated world. It’s not just about a high-resolution screen. All senses matter. My lightsaber sounds very convincing, but fortunately, the system doesn’t create smell, taste, touch, or pain. Overall, we can speak of low to high display fidelity, depending on the sense in question. Workshops with experts have shown how useful the model is for systematically and comprehensively comparing VR systems in this way.

If our systems ever become so advanced that we can no longer distinguish the simulation from the original, we will have achieved maximum fidelity. My idol, Ivan Sutherland, described such a system 60 years ago. He called it the “Ultimate Display.” Since then, we have made astonishing technological progress in this direction – but we are still far from reaching it.

Admittedly, my Jedi fantasies are not world-changing. But beyond gaming and entertainment, there are many other fields where realism in VR technology is crucial. In medicine, a tumor can be represented in 3D in VR to plan surgery. In pilot schools, VR is used for flight training. In car development and urban planning, VR allows designs to be viewed and collaboratively edited without material costs. In education, there are 3D learning modules on the solar system and atomic structure. A school class can even take a VR trip to the Taj Mahal and explore it in a virtual scavenger hunt. The possibilities are endless, and we are just beginning to tap into the potential of this technology.

For my research, my team and I developed VR systems for various applications and tested them in user studies. For example, during the pandemic, we investigated whether meetings in VR could be an alternative to video conferences. We also simulated the weight of virtual objects, since they don’t exist in reality and thus have no physical mass. For sports in VR, we had test subjects throw countless frisbees and kick soccer balls. We measured that they had more control over their throws and kicked more accurately when they could see their virtual hands and feet. We also examined how realistically virtual assistants should be displayed and how we can simulate fine motor skills of the hand in VR. These insights give an idea of how complex the topic is and how much there is still to learn.

Because higher realism is not always better. Sometimes, we deliberately want something unrealistic. One advantage of VR worlds is that they are not restricted by physical laws. There, I can simply flap my arms and fly away. Highly realistic systems can even be dangerous. If it’s no longer clear what’s real and what’s virtual at first glance, the technology could be misused for malicious purposes.

In many VR applications, however, high realism is fundamental. When we put users at the center of virtual world development, we can create convincing simulations with just the right level of realism. VR technology already enables astonishing things today. I am excited to see the technical progress of VR in the next 10 years and how this technology will enrich our everyday lives. What have you always dreamed of being or experiencing?

Als hätte ich ein Lichtschwert in der Hand

Mit Virtual-Reality-Technologie können wir künstliche Welten erleben, die sich verblüffend echt anfühlen. Für Anwendungen in Medizin, Bildung und Gaming ist entscheidend, dass die Simulationen realistisch sind. Meine Forschung zeigt, wovon Realismus abhängt und warum weniger auch mehr sein kann.

Als Kind habe ich davon geträumt, ein Jedi zu sein. Mit meiner Fantasie ließ ich Dinge schweben und wirbelte mit einem Stock umher, als wäre er ein Lichtschwert. Heute komme ich dem Jedi-Gefühl mit Virtual-Reality-Technologie so nah wie noch nie. Wenn ich in eine virtuelle Realität (VR) eintauche, kann ich ein blau leuchtendes Lichtschwert mit dem ikonischen Geräusch elegant um mich schwingen. Großes Kino – nur dass ich mittendrin bin.

Weiterlesen…

Statt auf einen flachen Bildschirm zu starren, sehe ich die Welt durch eine VR-Brille und bin unmittelbar im Geschehen. Schau ich mich nach dem Geräusch hinter mir um, geht die virtuelle Welt dort weiter. Ich sehe und höre den Planeten Tatooine nicht nur. Ich kann mich nach einem sandigen Stein bücken und ihn Luke Skywalker zuwerfen – mit meinem Körper statt mit Tastatur und Maus. Trotzdem erkenne ich sofort, dass ich lediglich eine Simulation erlebe. Ich spüre die schwere Brille auf meine Nase drücken und kann mich glücklicherweise nicht mit dem Lichtschwert verletzen. Mein Eindruck dieser Welt: ziemlich realistisch und doch eindeutig von der Realität zu unterscheiden.

Diese Einschätzung ist aus dem Bauch heraus schnell getroffen, aber „ziemlich realistisch“ ist aus wissenschaftlicher Sicht ziemlich ungenau. Hier setzt meine Promotionsforschung mit der zentralen Frage an: Wie realistisch sind Interaktionen in Virtual Reality und was ist der Effekt davon? In meiner Doktorarbeit habe ich erforscht, welche Faktoren ein VR-Erlebnis mehr oder weniger realistisch machen, wie man sie genau beschreiben kann und was das für die Entwicklung von virtuellen Erfahrungen bedeutet.

Nun fragen sich aber alle, die noch nie selbst auf Tatooine waren: Wie kann ein Lichtschwert überhaupt realistisch sein, wenn es gar keins gibt? Der Begriff „Fidelity“ (dt. Originaltreue) beschreibt es besser als „Realismus“. Man kennt das Wort vielleicht von High Fidelity Audio (HiFi). Hohe Fidelity bedeutet, dass eine Kopie oder Simulation dem Original sehr ähnlich ist. Wovon hängt also ab, wie exakt meine virtuelle Jedi-Ausbildung dem Original aus Star Wars entspricht?

Für VR-Anwendungen gibt es eine beeindruckende Vielfalt an raffinierten Lösungsansätzen und Technologien. Zum Beispiel unterschiedliche Geräte: Greife ich einen virtuellen Gegenstand mit einem Controller oder mit speziellen Handschuhen? Oder verschiedene Software-Lösungen: Werden detaillierte Schatten berechnet oder sieht die Welt wie in einem Comic aus? Genauso bei den Bedienungsformen: Kann ich ein Menü mit meiner Stimme oder meinen Augenbewegungen bedienen?

Damit man bei all der technischen Komplexität den Realismus eindeutig vergleichen kann, habe ich das Interaction Fidelity Model entwickelt. Dieses Modell nimmt uns für die Analyse an die Hand. Mit einer klaren Struktur und eindeutigen Begriffen hilft es, alle Einflussfaktoren für die Fidelity zu verstehen. Für die Kommunikation im Team ist das hilfreich, da wir Missverständnisse vermeiden und nichts übersehen.

Der Aufbau des Modells ist simpel. In einem Kreis werden alle Stufen der Interaktion zwischen Mensch und Computer durchlaufen: Das System erkennt unser Verhalten (Eingabe), passt die Simulation entsprechend an (Verarbeitung) und berechnet die System-Rückmeldung (Ausgabe), die wir sehen und spüren (Wahrnehmung). In der Praxis passiert das alles gleichzeitig, da wir die Simulation ständig durch unser Verhalten beeinflussen und wahrnehmen. Dieser Kreislauf wird jedoch gerne in acht Stufen unterteilt, um die einzelnen Vorgänge besser zu verstehen.

Jede dieser Stufen entspricht in meinem Modell einem Realismus-Faktor. Beispielsweise ist der erste Schritt, wie ich mich als Nutzer verhalte, also ob ich mich bewege, einen Knopf drücke oder etwas sage. Für unsere Analyse der Fidelity fragen wir also, wie sehr mein Verhalten in VR dem Verhalten eines Jedi entspricht. Diesen Faktor nenne ich „Action Fidelity“. Drücke ich einen Knopf, um das Lichtschwert zu halten, hat das geringe Action Fidelity. Umschließe ich den virtuellen Lichtschwert-Griff mit meiner Hand hat das hohe Action Fidelity. Insgesamt haben wir 8 dieser Faktoren, mit denen wir jegliche Interaktion mit VR-Systemen strukturiert analysieren können.

Ein anderes Beispiel ist „Display Fidelity“. Dieser Faktor beschreibt, wie originalgetreu das System die simulierte Welt darstellt. Dabei zählt nicht nur ein hochauflösender Bildschirm. Es kommt auf alle Sinne an. Mein Lichtschwert klingt sehr überzeugend, aber zum Glück erzeugt das System weder Geruch und Geschmack noch Berührungen und Schmerz. Insgesamt können wir von einer geringen bis hohen Display Fidelity sprechen, je nach Sinn. Workshops mit Expertinnen und Experten haben gezeigt, wie hilfreich das Modell dabei ist, auf diese Weise VR-Systeme strukturiert und umfassend vergleichen.

Sollten unsere Systeme irgendwann so ausgefeilt sein, dass wir die Simulation nicht mehr vom Original unterscheiden können, haben wir die maximale Fidelity erreicht. Ein solches System beschrieb mein Idol, Ivan Sutherland, bereits vor 60 Jahren. Er nannte es das „Ultimate Display.“ Seither haben wir technologisch erstaunlichen Fortschritt in diese Richtung gemacht – und sind doch noch weit davon entfernt.

Zugegeben sind meine Jedi-Fantasien wenig weltbewegend. Neben Gaming und Unterhaltung gibt es aber noch viele andere Einsatzgebiete von VR-Technologie, für die Realismus entscheidend ist. In der Medizin kann ein Tumor in VR dreidimensional dargestellt werden, um die Operation zu planen. In der Flugschule wird VR für das Training eingesetzt. Bei der Entwicklung von Autos und in der Stadtplanung kann man mit VR ohne Materialkosten Entwürfe ansehen und gemeinsam bearbeiten. In der Bildung gibt es 3D-Lerninhalte zum Sonnensystem und der Atomstruktur. Eine Schulklasse kann auch zusammen einen VR-Ausflug zum Taj Mahal machen und es bei einer virtuellen Schnitzeljagd erkunden. Die Möglichkeiten sind endlos und wir beginnen gerade erst, das Potential der Technik umzusetzen.

Für meine Forschung habe ich mit meinem Team VR-Systeme für verschiedene Anwendungen entwickelt und in Nutzerstudien getestet. Beispielsweise untersuchten wir in der Pandemie, ob Meetings in VR eine Alternative zu Videokonferenzen sind. Und wir simulierten das Gewicht von virtuellen Gegenständen, da diese ja in der Realität nicht existieren und damit keine Masse haben. Für Sport in VR haben wir Testpersonen unzählige Frisbees werfen und Fußbälle schießen lassen. Wir konnten messen: Sie haben mehr Kontrolle über den Wurf und schießen genauer, wenn sie die virtuellen Hände und Füße sehen. Wir haben auch untersucht, wie realistisch virtuelle Assistenten angezeigt werden sollten und wie wir die Feinmotorik der Hand in VR nachbilden können. Diese Eindrücke lassen erahnen, wie vielschichtig die Thematik ist und wie viel darüber noch zu lernen ist.

Denn hoher Realismus ist nicht immer besser. Manchmal möchten wir bewusst etwas Unrealistisches. Ein Vorteil von VR-Welten ist, dass sie nicht durch physikalische Gesetze eingeschränkt sind. Dort kann ich einfach mit den Armen flattern und wegfliegen. Sehr realistische Systeme können sogar gefährlich sein. Wenn nicht mehr auf den ersten Blick erkennbar ist, was echt und was virtuell ist, könnte die Technik für böswillige Zwecke eingesetzt werden.

In vielen VR-Anwendungen ist hoher Realismus jedoch grundlegend. Wenn wir bei der Entwicklung von virtuellen Welten die Nutzerinnen und Nutzer in den Mittelpunkt stellen, gelingen uns überzeugende Simulationen mit genau dem richtigen Level an Realismus. Mit VR-Technologie lässt sich heute schon Verblüffendes erreichen. Ich bin gespannt auf den technischen Fortschritt von VR in den nächsten 10 Jahren und wie die Technologie unseren Alltag bereichern wird. Was wollten Sie schon immer mal sein oder erleben?